Regulacje prawne, a GenAI. Jak się przygotować?

Generatywna sztuczna inteligencja (GenAI) ma zdolność analizowania danych oraz tworzenia nowych treści, takich jak tekst, obrazy, kod czy muzyka, co otwiera ogromne możliwości dla każdej organizacji. Aby skutecznie wdrożyć rozwiązania GenAI, warto dokładnie przeanalizować rekomendacje i regulacje prawne już na etapie planowania. Pozwoli to zapobiec potencjalnym nieprawidłowościom i zapewnić zgodność z obowiązującymi przepisami.

Rozpocznijmy od szczegółowej analizy rekomendacji od Amazon Web Services, a następnie przejdźmy do omówienia innych regulacji, które wspierają tworzenie polityki wykorzystania GenAI w organizacji.

Rekomendacje AWS

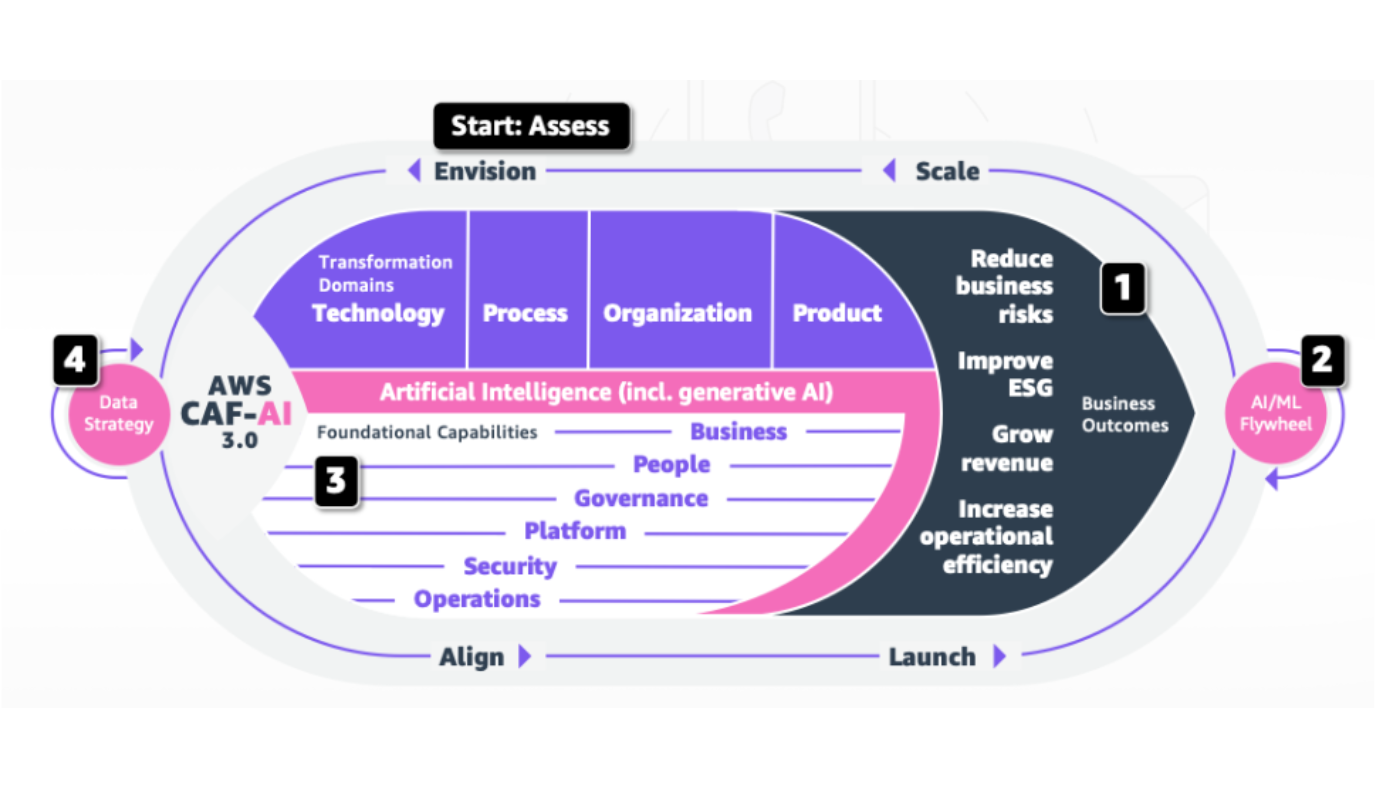

Wdrożenie każdej dużej technologii to złożony proces, zwłaszcza, jeśli chodzi o wykorzystanie sztucznej inteligencji, która rozwija się wyjątkowo dynamicznie. Choć każdy proces transformacji jest unikalny, istnieją sprawdzone wzorce skutecznego wdrażania GenAI. Jednym z nich jest zbiór dobrych praktyk od Amazon Web Services. Dokument nazywany jest AWS CAF-AI.

Na wstępie należy przyjrzeć się kluczowym elementom, dzięki którym zbudowanie polityki będzie dużo łatwiejsze.

Zdefiniowanie celów i zakresu

Firmy muszą jasno określić, w jakich obszarach zamierzają wdrażać rozwiązania generatywnej sztucznej inteligencji i jakie cele chcą osiągnąć dzięki niej. Najczęściej organizacje skupiają się na poprawie efektywności operacyjnej, optymalizacji procesów, skrócenia czasu wdrożenia nowych rozwiązań czy zwiększenie zadowolenia klientów. Najważniejszym elementem jest zidentyfikowanie działów i procesów, będących objętych polityką GenAI.

Procedury testowania i monitorowania systemów GenAI

Każdy model i rozwiązanie powinno zostać przetestowane pod kątem zgodności z wewnętrznymi standardami firmy i obowiązującymi regulacjami. Polityka powinna określać, jakie narzędzia są zatwierdzone do użycia i jak monitorować ich efektywność po wdrożeniu.

Zarządzanie ryzykiem i zgodność z przepisami

Polityka GenAI powinna obejmować szczegółowy plan zarządzania ryzykiem, w tym dostosowanie się do wymogów GDPR i AI Act. Należy uwzględnić klasyfikację ryzyka systemów GenAI, a także procedury zapewniające transparentność i bezstronność działania modeli sztucznej inteligencji. Kluczowe jest unikanie dyskryminacji i dbanie o ochronę danych.

Szkolenie i zaangażowanie pracowników

Aby proces wdrożenia GenAI działał efektywnie, pracownicy muszą być świadomi, jak korzystać z tej technologii w sposób etyczny i bezpieczny. Polityka powinna obejmować programy szkoleniowe zarówno dla kadry zarządzającej, jak i dla zespołów technicznych, które wdrażają i utrzymują systemy GenAI. To pomoże w pełnym zrozumieniu korzyści i zagrożeń związanych z GenAI.

Etyczne wykorzystanie GenAI

Ważnym elementem polityki GenAI jest ustalenie zasad etycznych, które firma będzie przestrzegać przy korzystaniu z generatywnej sztucznej inteligencji. Obejmuje to transparentność w komunikacji z klientami, bezstronność modeli oraz zgodność z wartościami firmy. Budowanie zaufania do GenAI, osób z organizacji i klientów to klucz do długofalowego sukcesu.

Zarządzanie danymi i zgodność z GDPR

Wdrożenie generatywnej sztucznej inteligencji wymaga strategii, w której kluczowe będzie zarządzanie danymi. Rozwiązania GenAI nie zadziałają bez dobrych danych i właśnie dlatego polityka powinna zawierać wytyczne dotyczące zbierania, przechowywania i przetwarzania danych, a także dbania o ich jakość i bezpieczeństwo. Przy tym wszystkim należy pamiętać, że firmy wdrażające GenAI muszą przestrzegać regulacji dotyczących ochrony danych osobowych, takich jak GDPR. Jest to szczególnie ważne przy trenowaniu modeli GenAI.

Opracowanie polityki dotyczącej generatywnej sztucznej inteligencji jest niezwykle istotne dla każdej organizacji. Dzięki niej budowane jest zaufanie klientów i pracowników poprzez etyczne i transparentne wykorzystanie potencjału GenAI, co sprzyja lepszym relacjom i pozytywnie wpływa na wyniki biznesowe. Dodatkowo pomaga w zarządzaniu ryzykiem, minimalizując zagrożenia prawne i operacyjne, związane na przykład z naruszeniem prywatności danych czy brakiem transparentności algorytmów.

Jak reaguje prawo na GenAI?

Kolejnym krokiem jest zrozumienie regulacji prawnych. Poniżej znajdziesz instytucje, jak i regulacje.

Grupa Robocza ds. Sztucznej Inteligencji (GRAI)

Grupa została stworzona z myślą o wskazaniu działań służących zapewnieniu w Polsce odpowiednich warunków dla rozwoju zastosowań AI zarówno w sektorach prywatnym i publicznym. Formuła Grupy jest otwarta i skupia szeroką reprezentację rynku.

Celem działania instytucji jest wsparcie przedsiębiorców w bezpiecznym i skutecznym wdrażaniu sztucznej inteligencji, zgodnie z najlepszymi praktykami oraz obowiązującymi regulacjami. GRAI dostarcza również rekomendacje oraz pomaga firmom zrozumieć standardy etycznego i transparentnego wykorzystania AI, ułatwiając im zgodność z wymogami prawnymi.

Efekty pracy Grupy są udostępniane na Portalu sztucznej inteligencji.

EU AI Act

EU AI Act stanowi pierwszy na świecie kompleksowy dokument regulujący obszar sztucznej inteligencji, który częściowo wejdzie w życie w 2025 roku, a w pełni od 2027. Akt ten klasyfikuje systemy AI według poziomu ryzyka i nakłada rygorystyczne wymogi na systemy podwyższonego ryzyka, wymagające zgodności z normami bezpieczeństwa i transparentności:

Niedopuszczalne ryzyko obejmuje systemy AI zakazane, zagrażające podstawowym prawom i bezpieczeństwu (np. systemy manipulacyjne lub wykorzystujące socjotechniki do wpływania na zachowanie)

Wysokie ryzyko widoczne jest w obszarach, takich jak medycyna, edukacja, czy rekrutacja, które muszą spełniać rygorystyczne wymagania techniczne i dotyczące transparentności:

- Ograniczone ryzyko wymaga określenia wymogów przejrzystości, np. chatboty, które muszą informować użytkowników o interakcji z AI,

- Minimalne ryzyko nie wymaga dodatkowych działań, gdyż nie stwarzają zagrożenia dla użytkowników. Są to np. filtry antyspamowe,

- Obowiązki dotyczące dokumentacji technicznej spadną głównie na dostawców systemów wysokiego ryzyka. Dlatego też, przestrzeganie EU AI Act może wymagać zatrudnienia specjalistów ds. zgodności i regularnych audytów.

Warto również zwrócić uwagę, że poza przepisami unijnymi, istnieją już inne przepisy regulujące, takie jak Digital Markets Act, Digital Services Act oraz regulacje branżowe, które mogą dotyczyć wdrażania rozwiązania GenAI. Warto być na bieżąco i obserwować zachodzące zmiany.

Skorzystaj z wiedzy innych

Wykorzystanie rozwiązań GenAI wymaga solidnego planu i znajomości najlepszych praktyk rynkowych, takich jak AWS CAF-AI. Warto korzystać z wiedzy specjalistów i dedykowanych partnerów, którzy pomogą zrozumieć kwestie prawne i opracować politykę GenAI zapewniającą bezpieczeństwo. Jeśli potrzebujesz wsparcia lub masz pytania, nasi eksperci są do Twojej dyspozycji pod adresem: kontakt@lcloud.pl.

Przeprowadzimy bezpłatne konsultacje i zaplanujemy Twoje wejście w świat generatywnej sztucznej inteligencji.